昨日,AI届“汪峰”Qwen团队发布了Qwen2.5-VL-32B-Instruct,作为Qwen2.5-VL系列模型的最新迭代,通过强化学习优化,以32B参数规模击败上代72B版本,展现出其更智能和轻量级的突出特点。

较前代模型在以下方面有了显著改进:

-

更符合人类偏好的回答:调整输出风格,提供更详细、格式更好的答案,更贴近人类偏好。 -

数学推理能力提升:在解决复杂数学问题方面,准确性得到显著提高。 -

精细图像理解和推理:在图像解析、内容识别和视觉逻辑推理等任务中,准确性和分析细节得到增强。

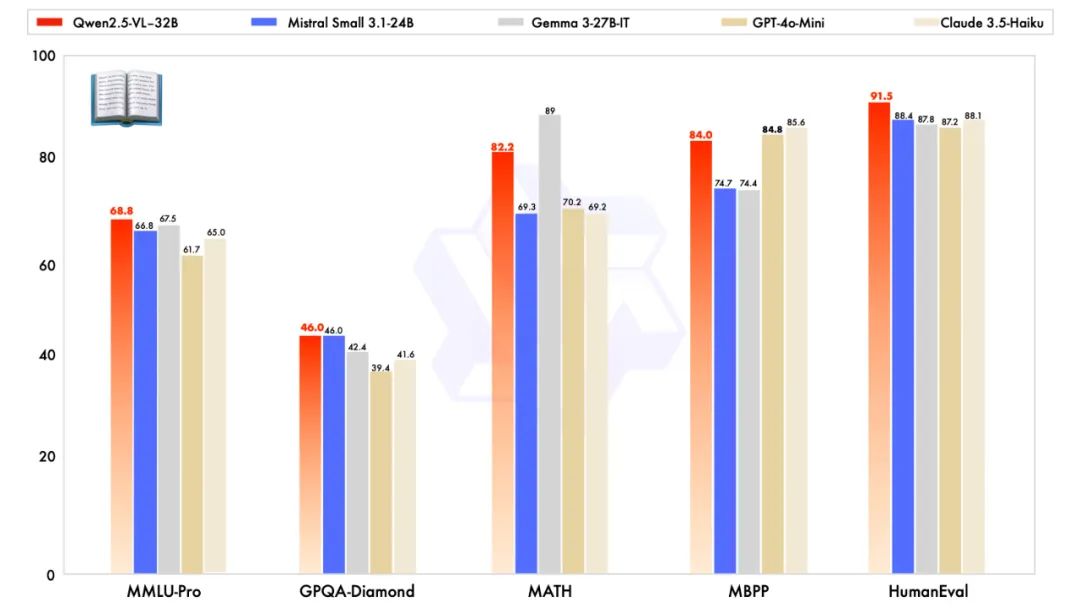

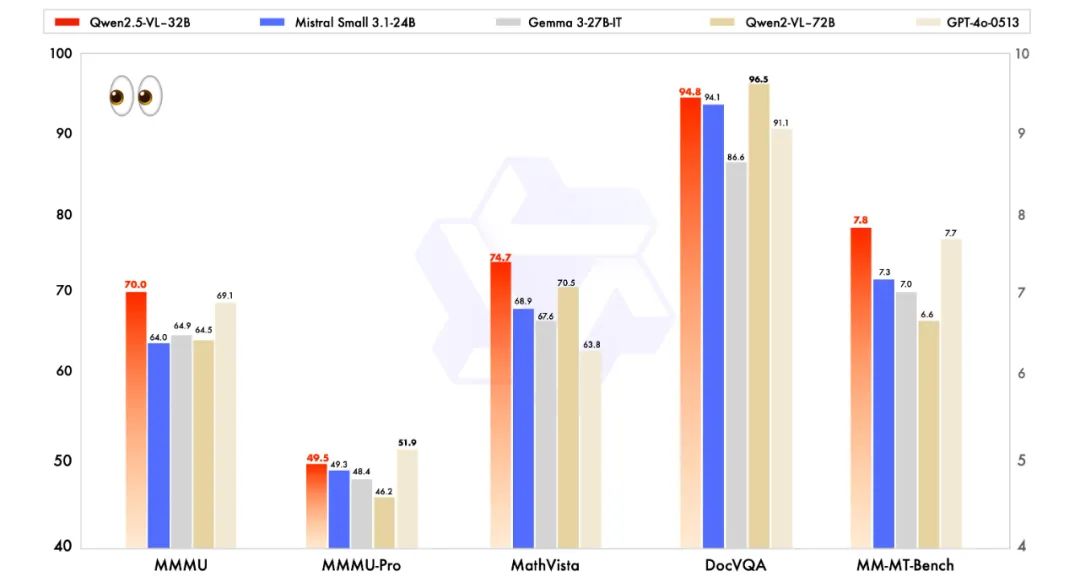

性能方面,Qwen2.5-VL-32B在多项基准测试中展现出超越基线模型的表现,例如Mistral-Small-3.1-24B和Gemma-3-27B-IT,甚至在多模态任务如MMMU、MMMU-Pro和MathVista中超越了更大的Qwen2-VL-72B-Instruct模型。在MM-MT-Bench基准测试中,该模型在主观用户体验评估方面也优于其前代Qwen2-VL-72B-Instruct。

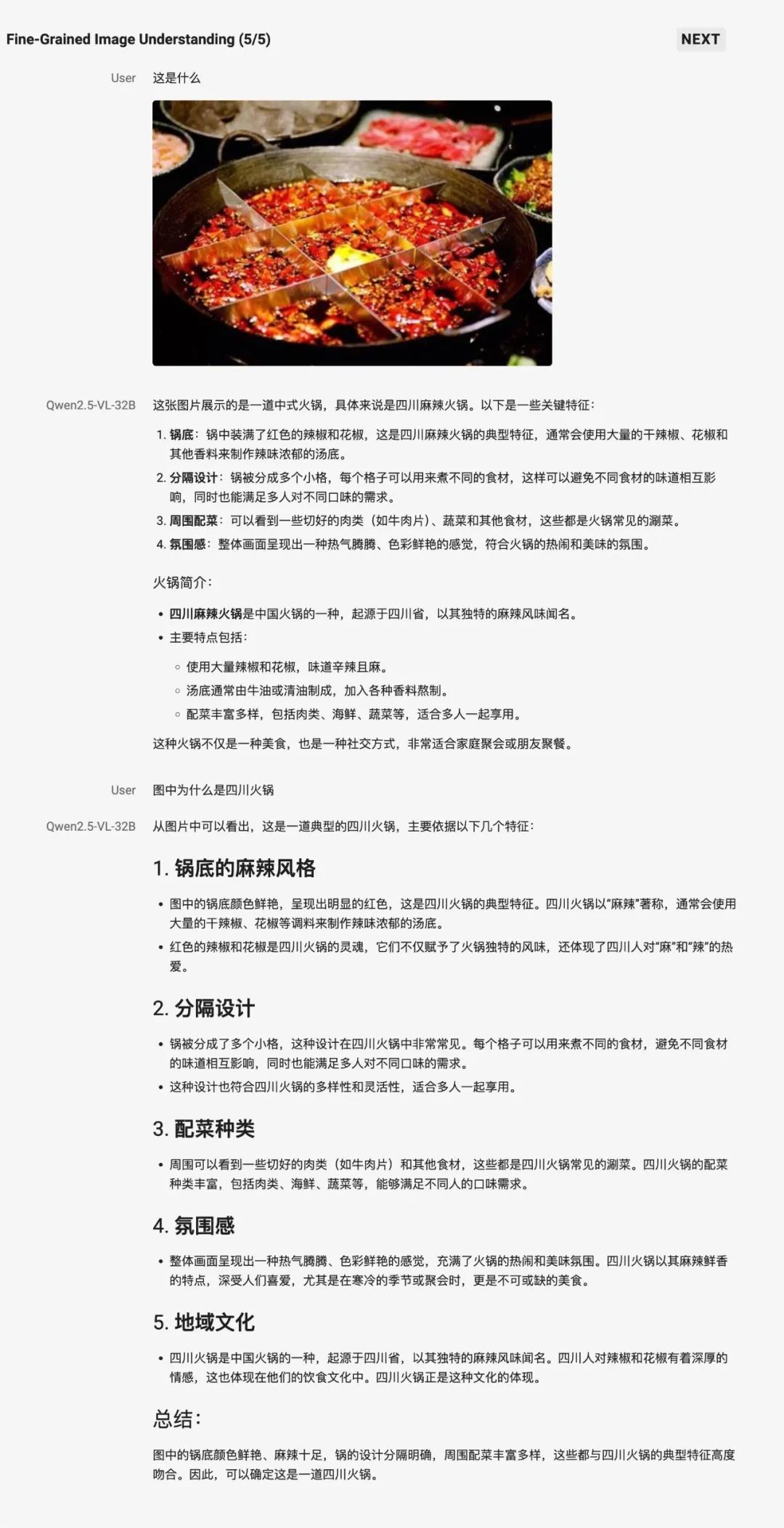

此外,Qwen2.5-VL-32B在视觉能力和纯文本能力方面均取得了顶尖表现。例如,在图像理解任务中,该模型能够分析一张中式火锅图片,识别其特征,如锅底的麻辣风格、分隔设计、配菜种类等。

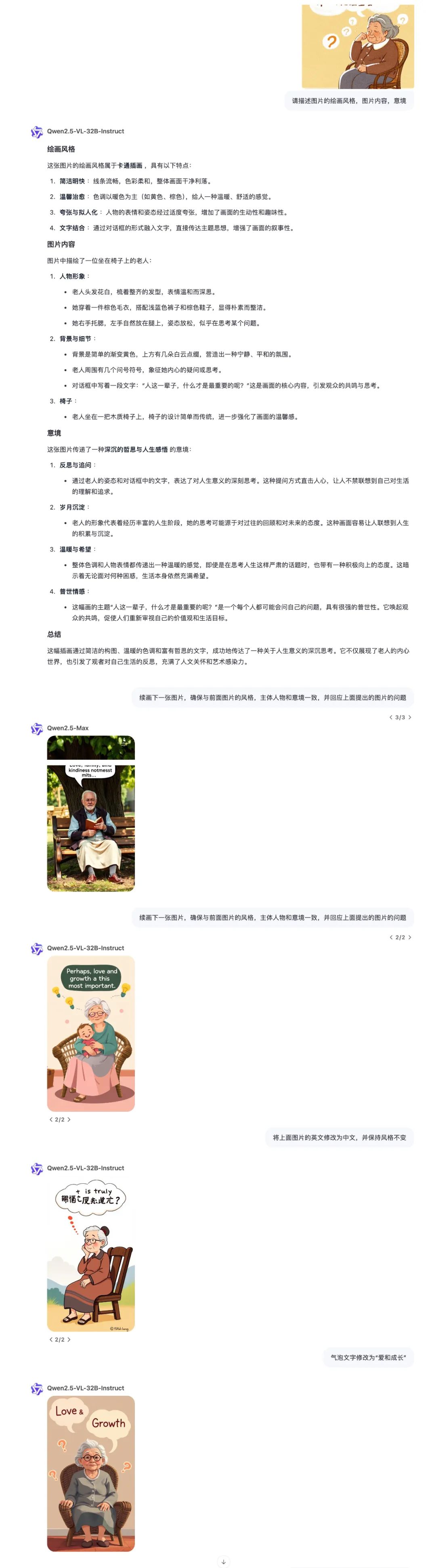

为了更直观感受,笔者选择了最近网络上流行的“治愈老奶奶”插画作为综合场景能力验证,让国产代表Qwen与当前多模态生图领域热门的模型grok和gemini做一比较。

Qwen系列:

从上面可以看出,对于识图来讲,这三个模型都不在话下,但在接下来基于多模态情景上下文下生图层面表现各有特点。Gemini最强,能够完整续写故事,并能很好保持人物和风格一致性,但对于文字控制不佳。grok支持局部的精细修改,但风格审美有些差强人意。Qwen在风格和英文文字控制上表现最好。

总而言之,Qwen2.5-VL-32B 是模型的大小和性能之间的平衡性的代表。小块头同样拥有大智慧!

新书推荐:

(文:AI工程化)