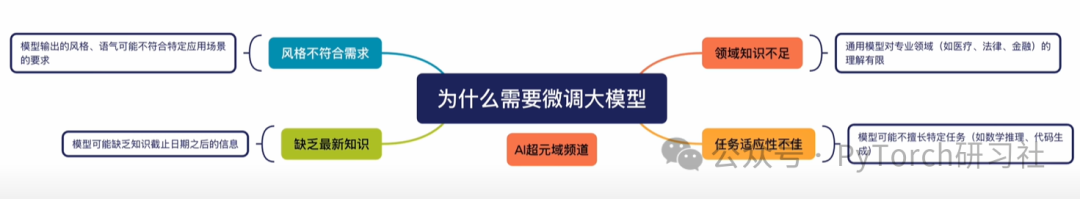

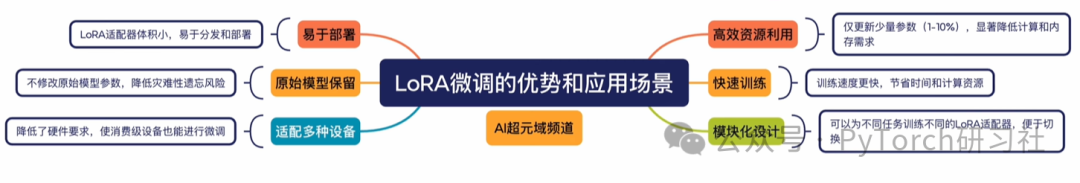

LoRA(Low-Rank Adaptation of Large Language Models,大型语言模型的低秩自适应)是一种流行的轻量级训练技术,可以显著减少可训练参数的数量。它的工作原理是将少量的新权重插入模型中,并且只训练这些权重。这使得使用 LoRA 进行训练的速度更快、内存效率更高,并且生成的模型权重更小(只有几百 MB),更易于存储和共享。LoRA 还可以与 DreamBooth 等其他训练技术结合使用,以加速训练。

1. 双模式操作能力:

-

普通对话模式: 适用于日常聊天场景。

-

思考模式( Thinking Mode ): 用于解决需要推理的问题。

2. 数学推理能力: 能够解决数学问题并展示详细的推理过程,如示例中的”解方程(x + 2)^2 = 0″。

3. 对话能力保持: 同时保持了自然对话的能力,能够进行流畅的多轮对话。

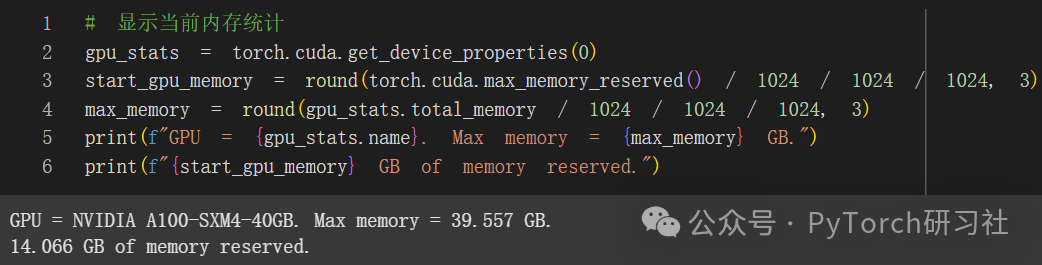

首先我们在谷歌 Colab 上选择算力,推荐使用 T4 GPU 或者 A100 GPU:

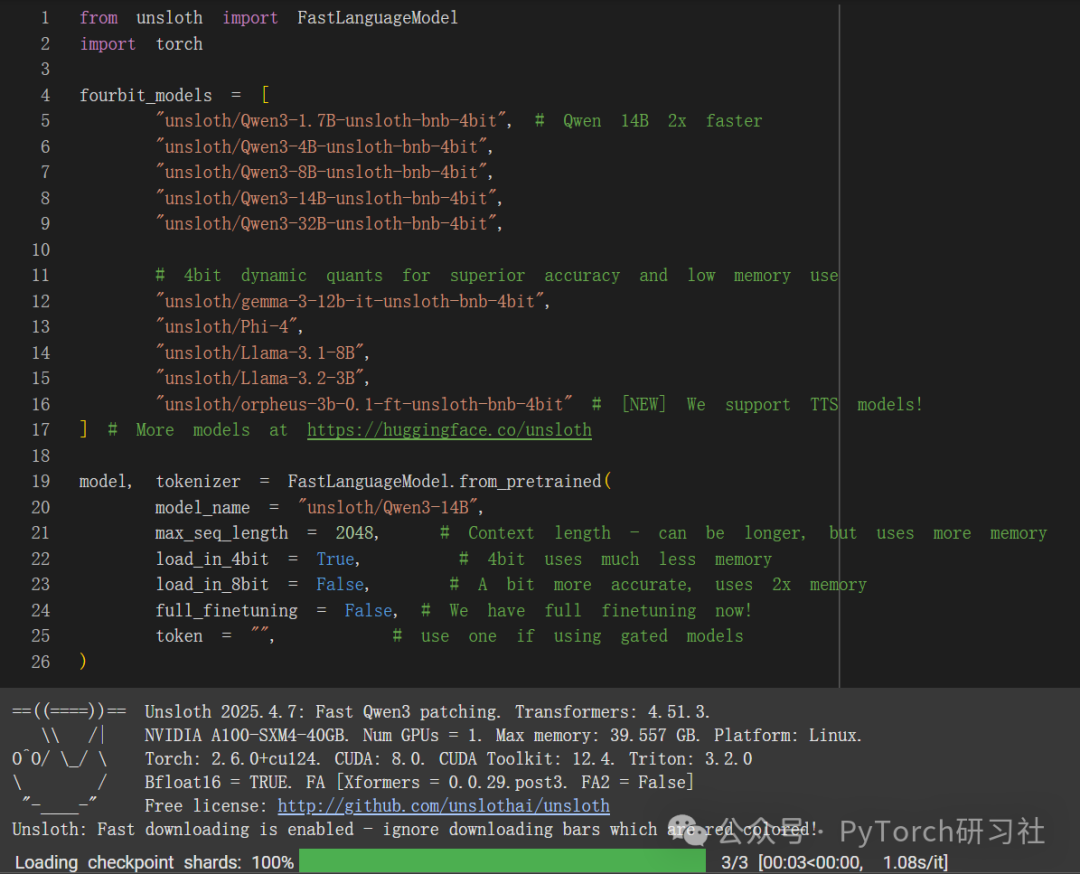

现在我们可以加载 14 B模型:

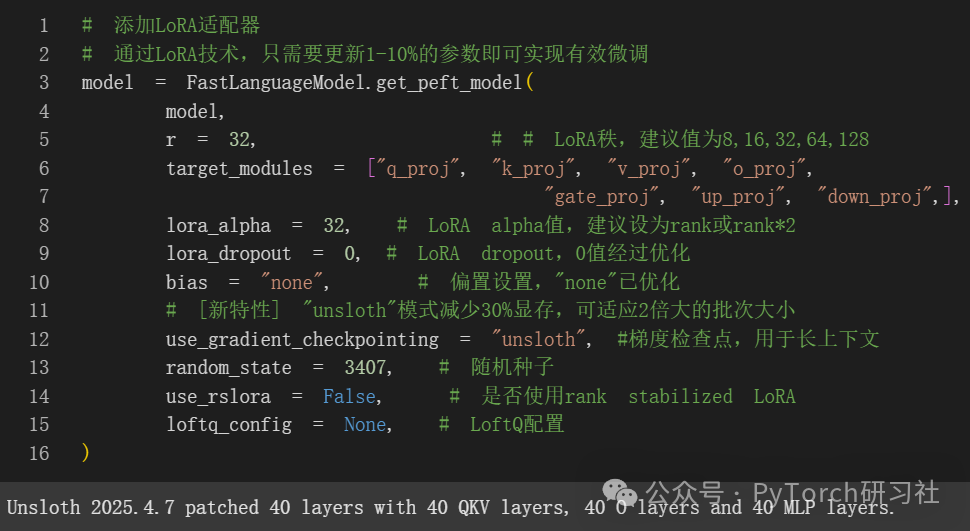

我们现在添加 LoRA 适配器,因此我们只需要更新 1% 到 10% 的参数!

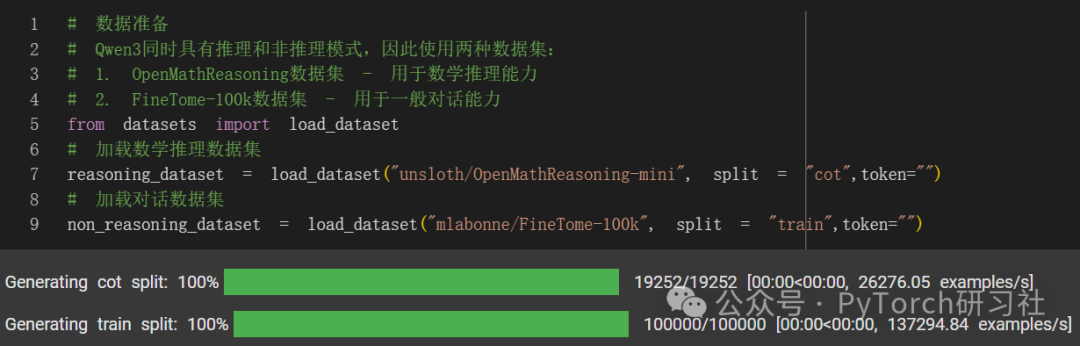

准备数据

Qwen3 既有推理模式,也有非推理模式。因此,我们应该使用两个数据集:

-

Open Math Reasoning 数据集,该数据集曾用于赢得 AIMO(AI Mathematical Olympiad,AI 数学奥林匹克 – 进步奖 2)挑战赛!我们从使用 DeepSeek R1 的可验证推理轨迹中抽取了 10%,其准确率超过 95%。

-

我们还利用了 Maxime Labonne 的 FineTome-100k 数据集(ShareGPT 格式)。但我们还需要将其转换为 HuggingFace 的常规多轮对话格式。

我们现在将推理数据集转换为对话格式:

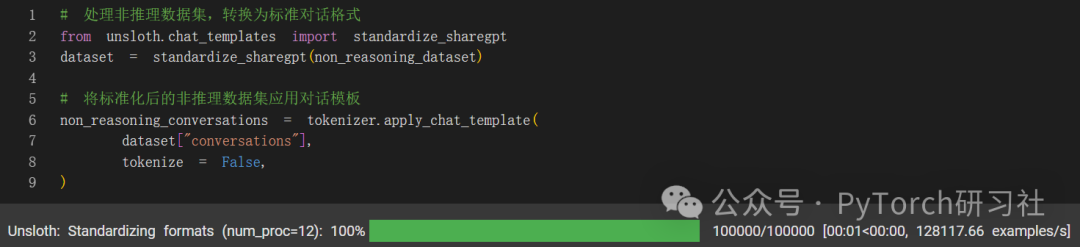

接下来,我们将非推理数据集也转换为对话格式。

首先,我们必须使用 Unsloth 的 standardize_sharegpt 函数来修复数据集的格式。

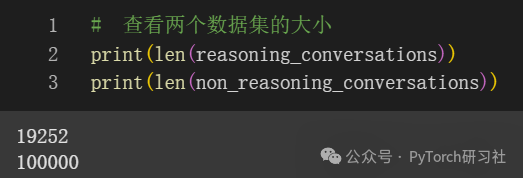

非推理数据集要长得多。假设我们希望模型保留一些推理能力,但我们特别想要一个聊天模型。

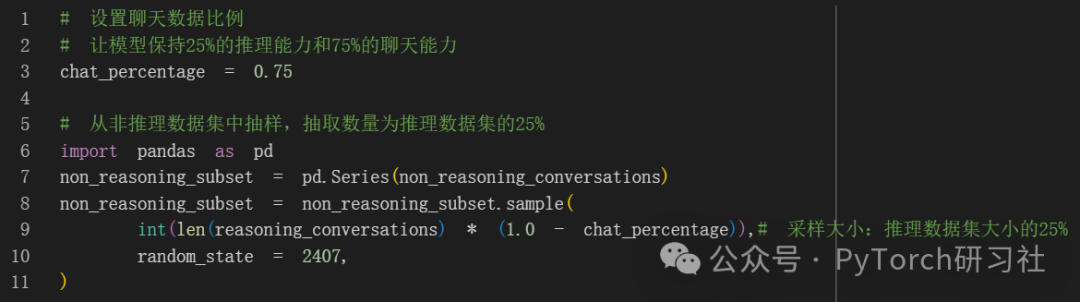

让我们定义一个纯聊天数据的比例。目标是定义两种数据集的某种混合。让我们选择 25% 的推理数据和 75% 的聊天数据:

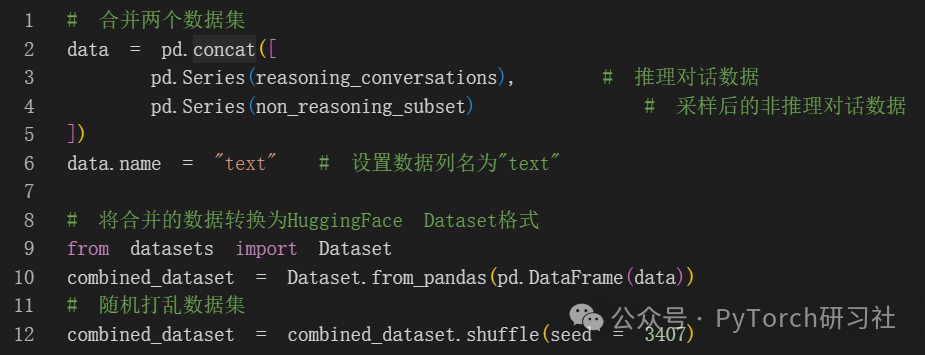

最后合并数据集:

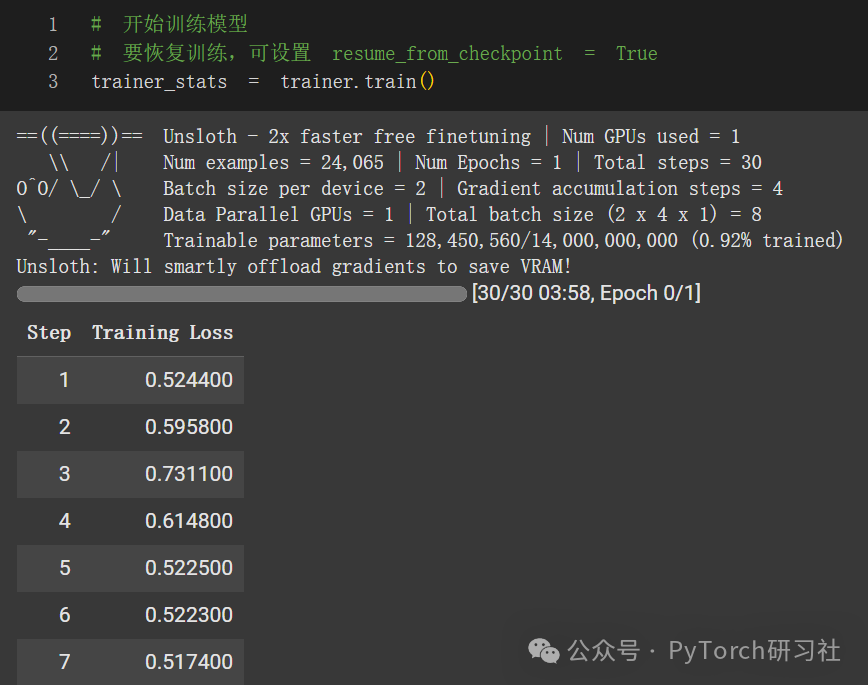

训练模型

现在让我们使用 Huggingface TRL 的 SFTTrainer!我们执行 60 步来加快速度,但你可以设置 num_train_epochs=1 进行完整运行,并关闭 max_steps=None。

让我们开始训练模型吧!要恢复训练,请设置 trainer.train(resume_from_checkpoint = True)

推理

让我们通过 Unsloth 原生推理来运行模型!根据 Qwen-3 团队的说法,

-

推理的推荐设置是:temperature = 0.6、top_p = 0.95、top_k = 20。

-

对于基于普通聊天的推理,temperature = 0.7、top_p = 0.8、top_k = 20。

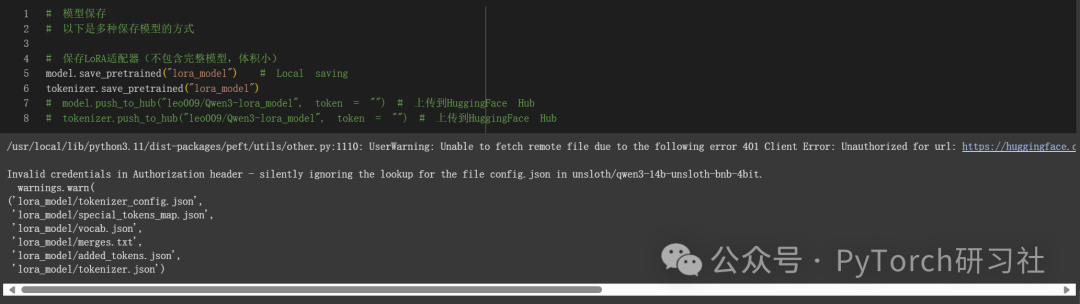

保存、加载微调模型

要将最终模型保存为 LoRA 适配器,请使用 Huggingface 的 push_to_hub 进行在线保存,或使用 save_pretrained 进行本地保存。

[注意] 这仅保存 LoRA 适配器,而不是完整模型。后面我来介绍如何保存为 16 位或 GGUF 格式。

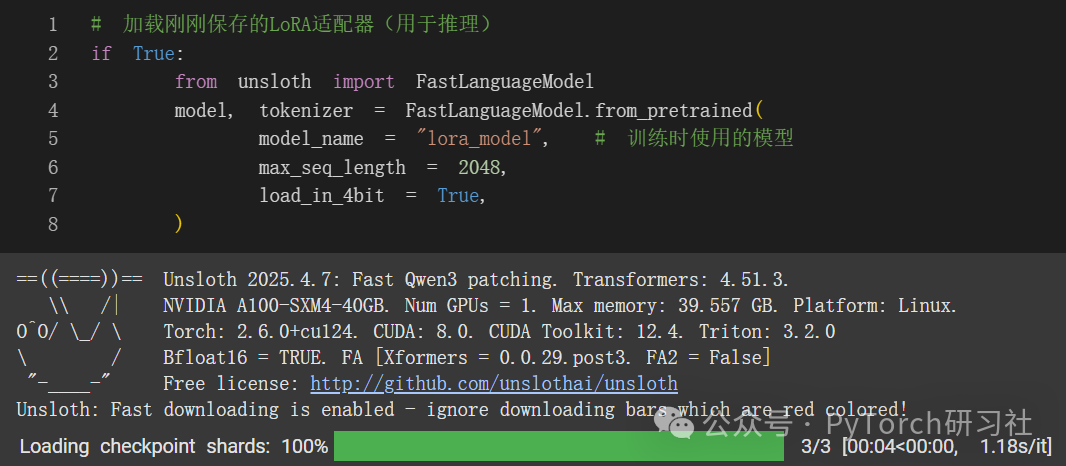

现在,如果你想加载我们刚刚保存用于推理的 LoRA 适配器,请将 False 设置为 True:

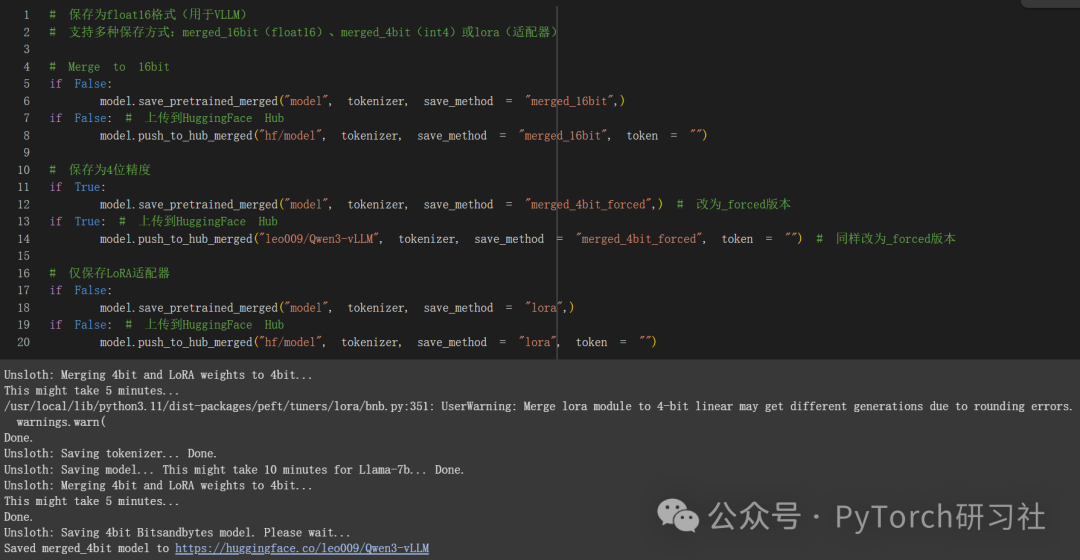

保存为 VLLM 的 float16

选择 merged_16bit 保存 float16,或选择 merged_4bit 保存 int4。使用 push_to_hub_merged 上传到你个人的 Hugging Face 账户!

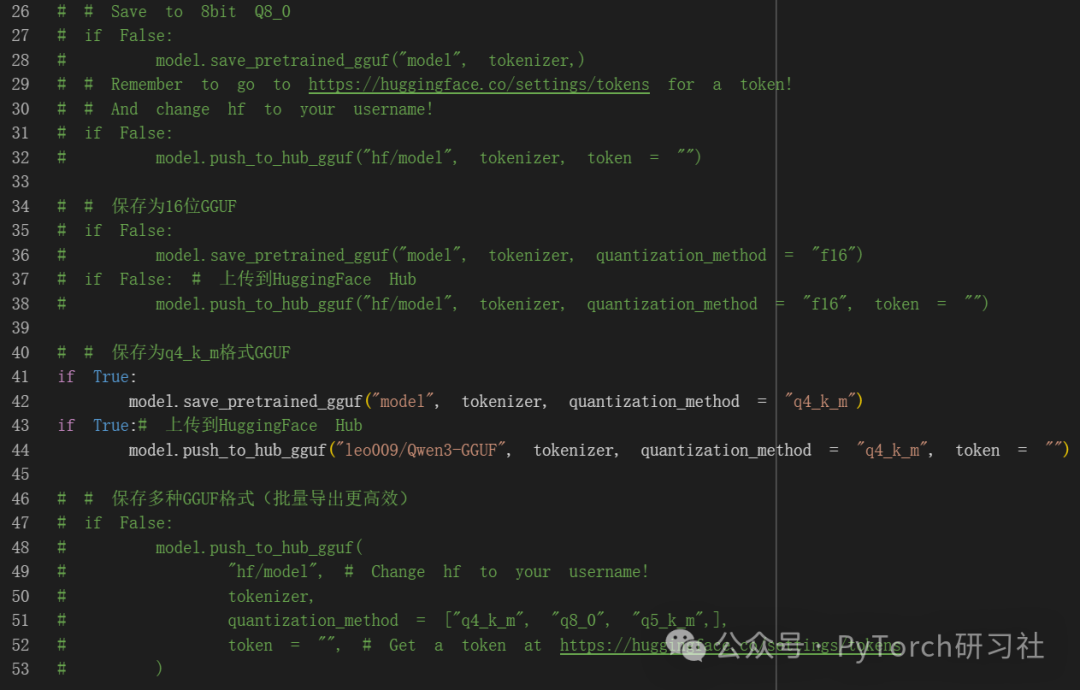

GGUF / llama.cpp 转换

使用 save_pretrained_gguf 进行本地保存,使用 push_to_hub_gguf 上传到 HF。

-

q8_0 – 快速转换。资源占用较高,但通常可以接受。

-

q4_k_m – 推荐。使用 Q6_K 处理 attention.wv 和 feed_forward.w2 张量的一半,否则使用 Q4_K。

-

q5_k_m – 推荐。使用 Q6_K 处理 attention.wv 和 feed_forward.w2 张量的一半,否则使用 Q5_K。

本地部署

接下来就是将 GGUF 文件下载到本地,以便本地部署运行。

加入星球获取精心打造的提示工程、RAG和Agent开发实践教程。

https://colab.research.google.com/drive/1pfv8UvNyLhB0ZKbhl7jbCeHcHBUN12Ai?usp=sharing#scrollTo=iX3Hv8YzBKyr(文:PyTorch研习社)