6 月 16 日,腾讯 AI Lab 推出并开源 SongGeneration 音乐生成大模型,专注解决音乐 AIGC 中音质、音乐性与生成速度这三大共性难题,基于 LLM-DiT 的融合架构,模型在保持生成速度的同时,显著提升了音质表现,生成歌曲的准确度相较部分商业闭源模型表现出相当甚至更优的质量,同时在整体表现、旋律、伴奏、音质与结构等维度也优于现有多数开源模型。

此外,SongGeneration 模型还支持文本控制、多轨合成与风格跟随等功能,既满足面向 C 端创作者的可玩性,又兼具 B 端的稳定性与拓展性,构建出面向未来的音乐 AI 生产力工具。

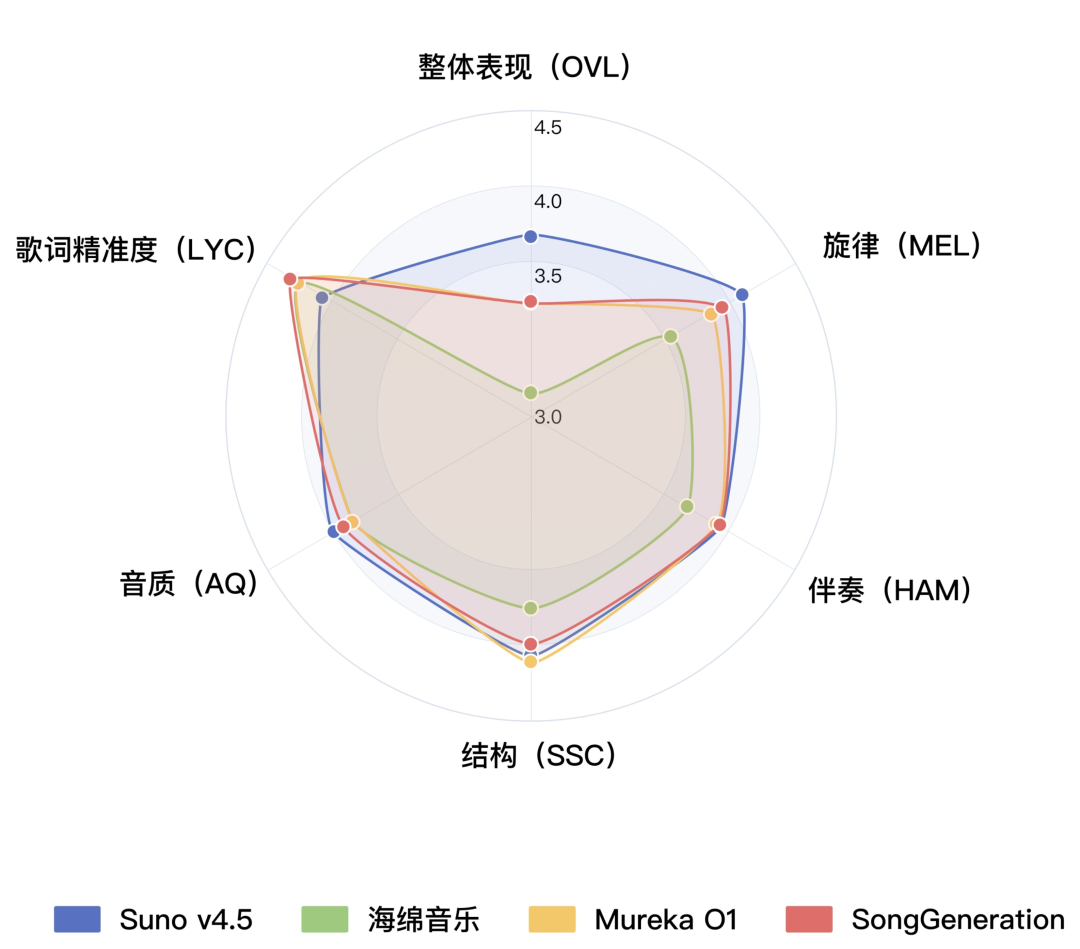

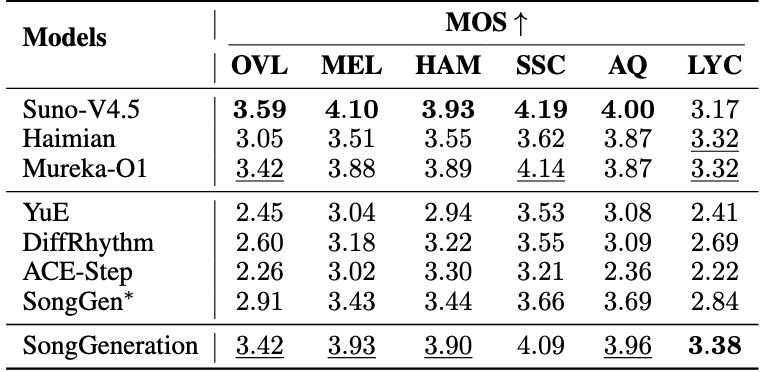

图 1 商业模型主观评测结果

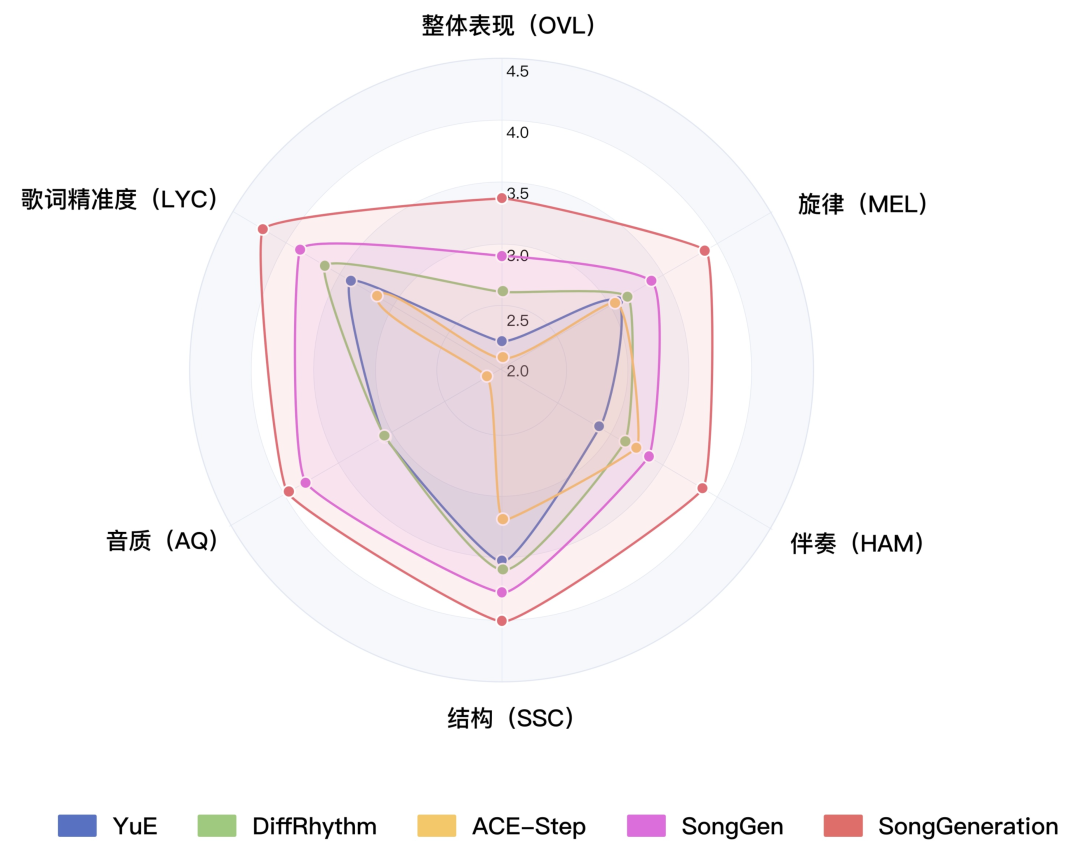

图 2 开源模型主观评测结果

相较于传统基于规则或小型模型的方式,基于大模型的音乐生成模型在旋律的长程连贯性、潜在风格迁移能力以及音色建模的表达维度上,展现出更强的泛化能力和生成潜力。AI 音乐创作正从过去的 “辅助工具” 迈向 “智能共创” 的新阶段,被广泛应用于短视频配乐、游戏音效、虚拟人演出、商业广告以及个人音乐创作等场景。

当前主流音乐生成大模型虽已初步实现 “文本到音乐” 的生成能力,但仍面临一系列关键瓶颈。在此背景下,腾讯 AI Lab 推出 SongGeneration 音乐生成大模型,专注解决音质、音乐性与生成速度这三大共性难题。

SongGeneration 预期目标分为技术与应用两个层面:在技术层面,致力于实现业内领先的音质表现、音乐性与生成速度,支持多语种歌词输入、一键式歌曲生成、风格迁移等任务,全面适配中英文流行、嘻哈、古风、电子等多样化曲风;在应用层面,推出面向开源社区的友好版本,广泛赋能内容创作平台、虚拟人项目、游戏厂商以及音乐人创作流程,构建开放、灵活、可持续的音乐 AI 生态系统。SongGeneration 音乐大模型的推出不仅代表着技术能力的跃升,更是对 “人人皆可创作” 这一音乐未来愿景的坚实回应与有力推动。

一、模型性能及效果展示

SongGeneration 已支持多项核心功能,均可在开源版本中方便调用。这些功能不仅在操作上简洁直观,更在生成过程中提供了高度的可控性,使用户得以在 “AI 辅助创作” 中真正拥有主导权。以下是其主要功能概览:

-

文本控制:用户仅需输入关键词文本(如 “开心 流行”、“激烈 摇滚”)即可实现风格与情绪控制,SongGeneration 会基于输入文本生成高质量的完整音乐作品。

-

风格跟随:用户可自行上传 10 秒以上的参考音频,SongGeneration 会自动生成风格一致的全长新曲,覆盖流行、摇滚、中国风、“神曲” 等多种流派。生成歌曲在保持风格一致性的同时,拥有较好的音乐性表现。

-

多轨生成:SongGeneration 能够自动生成分离的人声与伴奏轨道,同时保证旋律、结构、节奏与配器的高度匹配。

-

音色跟随:SongGeneration 支持基于参考音频的音色跟随功能,生成歌曲具备 “音色克隆” 级别的人声表现,听感自然、音质出众的同时,兼具卓越的情感表现力。

二、技术方案

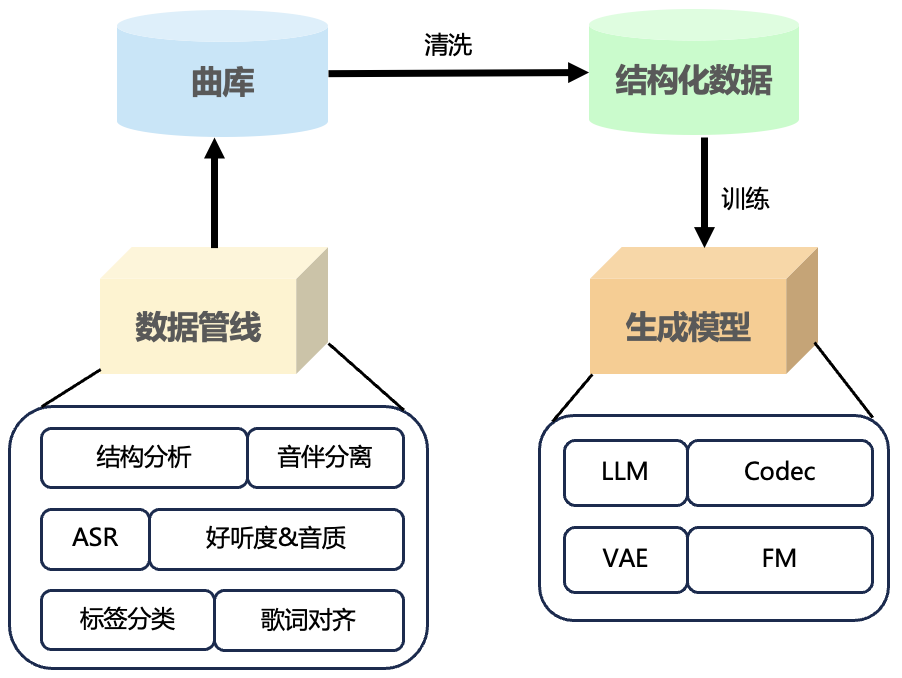

SongGeneration 训练架构包含数据管线和生成模型两部分。首先 SongGeneration 搭建了一套包含了音伴分离、结构分析、歌词识别等模块的音乐数据管线,通过管线可以从原始音频中得到准确的歌词数据,同时获得结构、曲风、音质等标签数据,然后把这些数据送入到生成模型中进行训练。

图 3 SongGeneration 训练架构

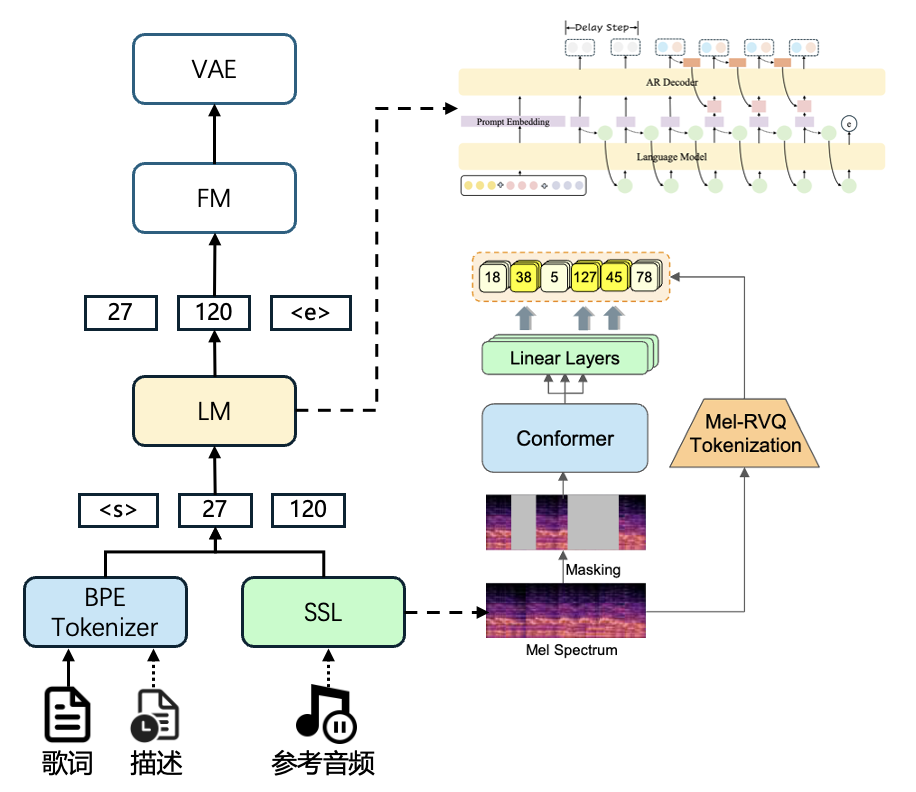

训练得到的生成模型 SongGeneration,总参数量仅为 3B 左右,随后在海量中英文歌曲上进行了预训练。如图所示,它由 codec、LM、FM、VAE 等部分组成,每个模块都是单独训练的。其中 codec 和 LM 在模型中起着举足轻重的作用。

Music Codec,模型参数约为 1B,用于对音乐进行编解码,能以超低比特率将 48kHz 的双通道音乐压缩成 25Hz 的离散表征,并实现高保真的还原。

Music LM,模型参数约为 2B,用于根据用户指令(歌词,文本描述,音频提示)生成完整的歌曲。

基于这两个组件,SongGeneration 可以高效地根据用户指令生成 48kHz 采样率的音乐。

图 4 SongGeneration 模型架构

三、技术创新点

这一节中主要介绍 SongGeneration 的实现细节,以及在以下四大领域内突破性的技术创新。

1、低比特率音乐编解码

Token 作为音乐生成系统的核心桥梁,不仅承担着语言模型的预测目标,还直接决定了高质量双通道音乐的还原效果。鉴于语言模型在长序列预测过程中容易产生幻觉现象,并且预测误差会随序列长度的增加而累积,因此,编解码器的设计需在保证音乐信息高质量重建的前提下,尽可能降低码率和比特率,从而减轻语言模型的预测难度,并提升音乐还原的整体质量。

音乐生成中的编解码一直是业界公认的难题,主要体现在以下几个方面:

-

复杂的成分结构:与仅包含人声的语音不同,音乐融合了丰富的背景伴奏与人声,两者之间存在复杂的相互作用和和谐关系。相比只需关注单一声学特征的语音或声学事件,音乐的多元成分使得建模难度大大提升。

-

庞大的数据量:高品质音乐通常为 44.1kHz 或 48kHz 的双通道格式,而传统语音仅为 16kHz 单通道。以 4 分钟的完整歌曲为例,48kHz 双通道音乐的数据量几乎是 16kHz 单通道语音的 6 倍。以常见的 75Hz 编码器为例,其编码整首歌曲的长度高达 153,600,这极大增加了语言模型的建模压力,直接影响音乐生成的效果。

-

声学与语义的双重桥接:与传统音频编解码不同,音乐生成的编解码不仅要保留足够的声学特征以实现高质量还原,还需包含丰富的语义信息以便语言模型准确预测。单一关注声学或语义特征都难以满足音乐生成的复杂需求。

针对上述挑战,SongGeneration 创新性地提出了业内开源模型中最低比特率、最低码率的双通道 48kHz 高质量音乐编解码器。SongGeneration 的音频编解码器实现了在仅 25Hz 的极低码率和 0.35kbps 的超低比特率下能够达到目前最好的音乐重建效果,极大减轻了语言模型的建模负担,为高质量音乐生成提供了坚实基础。

此外,为了更精准地建模人声与伴奏的关系,SongGeneration 设计了两种创新的编码模式:混合轨道和双轨道。混合轨道模式将人声和伴奏进行统一建模,整体编码音乐信息,确保人声与伴奏的和谐与连贯;而双轨道模式则将人声与背景音乐分别独立建模编码,使两者的细节表现更加清晰,使得重建更高质量的音乐。

2、多类别 token 并行预测

在 SongGeneration 之前,主要的学界工作偏向于采用双轨预测策略来解决音乐中人声和伴奏联合建模的问题,并且通过交错预测模式缓解了二者之间的干扰。但分别预测的人声和伴奏会出现严重的不和谐,严重影响到用户听感,且交错模式带来的序列长度倍增问题进一步限制了这类方法的可扩展性。为解决这个问题,SongGeneration 首个提出了 “混合优先,双轨其次” 的多类别 token 并行预测策略。

具体来说,SongGeneration 首先通过一个语言模型对混合 token 进行预测,指导旋律、节奏、节拍等高级结构信息的整体安排,确保人声与乐器的和谐。在此基础上,SongGeneration 通过一个扩展的自回归解码器进一步建模双轨 token,以捕捉人声和伴奏轨道各自的细粒度的变化从而提升音质和音乐性。两个模块之间以隐藏向量作为桥梁紧密连接,在不显著增加序列长度的情况下既实现了并行预测,又避免了 token 之间的相互干扰。

3、多维度人类偏好对齐

由于歌曲生成领域可用的数据集长期以来一直面临质量极不均衡和音乐标注不可靠的问题,目前开源的音乐生成大模型的效果和鲁棒性都受到了限制。一方面,在这种质量参差不齐的数据上训练的模型虽然能够生成歌曲,但无法学习到关于音乐性的先验知识,导致生成的歌曲难以符合听众的偏好。另一方面,不可靠的标注严重影响了模型遵循用户指令的能力,这不仅导致了较高的音素错误率(PER),也严重影响到了提示驱动的控制能力。在自然语言处理和图像生成领域,这个问题经常通过高质量数据微调或强化学习来解决。但高质量、高音乐性的歌曲由于版权限制无法获取,且相比于预训练数据数量要少很多;音乐标注需要专业的音乐知识和背景,且具有多个维度的需求,这两种办法都难以直接应用到音乐生成领域。

SongGeneration 是业内已知首个对齐了多维度人类偏好的音乐生成大模型,以较低的成本有效提升了由于数据匮乏导致的音乐性问题和指令遵循问题。我们重点关注了对用户使用体验具有显著影响的音乐性偏好,歌词对齐偏好和提示一致性偏好。SongGeneration 首先设计了一种低成本的半自动数据构建方法,针对上述三种偏好生成分别生成了对应的大规模偏好数据对。

-

音乐性偏好:通过少量人工标注评分数据训练的奖励模型区分胜负对

-

歌词对齐偏好:通过预训练的 ASR 模型计算音素错误数构建胜负对

-

提示一致性偏好:通过 MuQ-MuLan 计算的文本-音频以及音频-音频相似度构建胜负对

随后,SongGeneration 提出了一种基于插值的直接偏好优化(DPO)以同时解决歌词对齐、提示一致性和音乐性等挑战。此外,该方法还支持通过可控的插值系数实现性能的平滑过渡,以满足特定需求。

4、全新的三阶段训练范式

针对歌曲生成的复杂性和数据稀缺的特点,SongGeneration 提出了一种全新的三阶段训练范式,以进一步优化基于语言模型的音乐生成:预训练、模块化扩展训练和多偏好对齐。

-

预训练:在大型音乐数据集上仅训练语言模型,以初步对齐不同条件输入与音乐表征之间的模态。在此阶段,AR 解码器被冻结,以便语言模型专注于混合 token,为生成多样性和人声与乐器和谐性奠定基础。

-

模块化扩展训练:训练模型中的扩展模块(如自回归解码器),使其能根据混合 token 中预先确定的音乐结构知识并行建模双轨 token,从而提升音质和音乐性。为保留预训练知识,预训练阶段中训练的所有模块(语言模型)被冻结。

-

多偏好对齐训练:以模块化扩展训练阶段获得的模型为基础,整合半自动的数据构建方式和多维度人类偏好对齐,使模型在能生成音乐的基础上进一步朝遵循人类指令,生成好听的音乐演变。针对不同的需求可以考虑使用不同的差值系数以平衡不同的偏好。

四、评测方案和结果

在评测环节,SongGeneration 联合中国传媒大学音乐与录音艺术学院萧萍副教授 AI 音乐科研团队,建立了一套基于客观分析和主观感知的评价体系,并对 SongGeneration 和三款商业模型(Suno v4.5、海绵音乐、Mureka O1)、四款开源模型(YuE、DiffRhythm、ACE-Step、SongGen)的音乐生成表现进行了全方位的主客观评测。评测涵盖音乐性、音质等多个关键维度,能够全面反映模型在音乐生成中的综合表现。

-

客观工具评测(第三方开源模型评测):

-

制作质量(PQ):侧重于音频的技术质量,而非主观感受。评估要素包括清晰度与保真度、动态范围、频率分布以及空间化表现等。

-

制作复杂度(PC):关注音频场景的复杂性,通常通过音频成分的数量来衡量。

-

内容欣赏度(CE):涉及音频的情感冲击力、艺术技巧、艺术表现力以及听众体验等方面。

-

内容实用性(CU):评估该音频作为内容创作素材的可用性或使用可能性。

-

主观人工评测(普通用户 + 专业音乐人评测):

-

旋律(MEL):评估旋律的动听程度、情感表达能力以及音乐线条感,是否与整体风格或预期相一致。

-

伴奏(HAM):伴奏的色彩丰富度、配器的多样性与协调性,以及与主旋律之间的融合程度。

-

结构(SSC):乐句起止与过渡是否自然清晰、段落结构的可识别性、相似段落的合理重复,以及节奏的稳定性。

-

音质(AQ):音频是否饱满、清晰,是否存在杂音或底噪,同时考察人声与各类乐器的辨识度及其音色还原程度。

-

歌词准确度(LYC):歌词与演唱内容的匹配度,包括是否存在多字、少字、歌词错配等问题,以及音乐段落中是否出现不自然的重复或机械循环。

-

整体表现(OVL):综合感知旋律、伴奏、音乐结构、音质表现与歌词准确度等多个要素后,对音乐作品产生的总体喜爱程度。

表 1 客观对比评测

表 2 主观对比评测

整体结果显示,SongGeneration 在开源模型中稳居第一,在商业模型中也位列前茅,具备显著的竞争优势。

在客观测评的横向对比中,SongGeneration 在 CE(内容欣赏度)、CU(内容实用性)和 PQ(制作质量)三个维度中均位列榜首,在 PC(制作复杂度)维度也处于领先位置。这表明 SongGeneration 不仅具备较高的技术完成度与音频呈现质量,还在艺术表达力、主观愉悦感和潜在应用价值方面展现出强劲的综合能力,能够兼顾听觉体验与实际创作需求。

主观评测中,SongGeneration 在歌词准确度上超越了包括 Suno 在内的一众大模型,这体现出其在语音与文本对齐能力上的显著优势,也反映出其在内容生成细节处理方面的成熟度。

在旋律、伴奏、音质和整体表现等维度,SongGeneration 同样处于领先位置,与 Suno 最新发布的 V4.5 版本难分高下。这表明,SongGeneration 不仅在音乐性表达上细腻动人,在音质层面也表现出业内顶尖的清晰度与层次感,具备媲美主流商业模型的综合生成能力。同时,模型在生成音乐的结构维度也做到了开源第一,并与商业模型难分伯仲。清晰且富有层次的结构不仅有助于旋律与伴奏的展开,也能增强整体音乐的连贯性与情感表达,从而提升听众的沉浸感与记忆点。

五、体验方式和地址

目前,SongGeneration 模型已登陆 Hugging Face,欢迎在线体验!同时,全部模型权重与代码已全面开源 ,诚邀大家下载、复现、微调,并提出宝贵的意见。此外,AI Lab 长期开放多模态大模型、自适应自演进 agent、音乐生成等方向的算法岗位,欢迎优秀人才加入。

-

Huggingface:

https://huggingface.co/tencent/SongGeneration

-

Code:

https://github.com/tencent-ailab/SongGeneration

-

论文:

https://arxiv.org/abs/2506.07520

-

SongGeneration 模型体验地址:

https://huggingface.co/spaces/tencent/SongGeneration

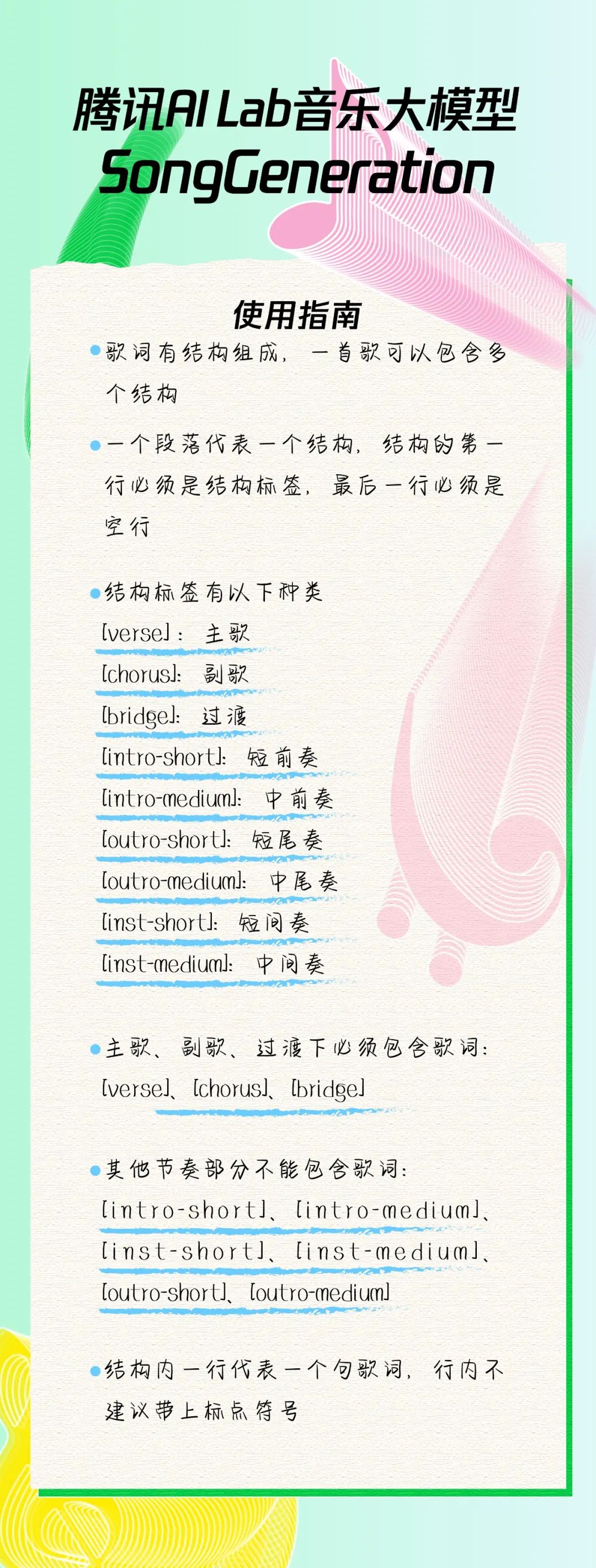

图 5 SongGeneration 使用指南

©

(文:机器之心)