机器之心

机器之心

年末惊喜!ByteDance Research视频理解大模型「眼镜猴」正式发布

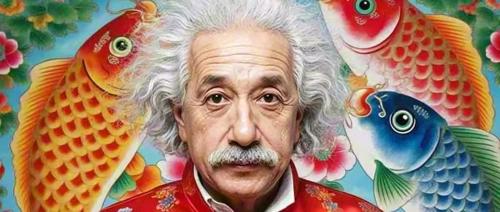

ByteDance Research 的视频理解大模型眼镜猴(Tarsier)发布了第二代模型 Tarsier2 及相关技术报告。Tarsier2 在影视名场面分析和视频描述任务上表现突出,展示了强大的视频理解和生成能力。

年末重磅!ByteDance Research视频理解大模型「眼镜猴」正式发布

ByteDance Research 的视频理解大模型眼镜猴(Tarsier)迎来了重大更新,发布了第二代模型 Tarsier2 及相关技术报告。Tarsier2 能够分析复杂的影视名场面,并对真人和动画、横屏和竖屏、多场景和多镜头的视频进行描述,其性能超越了 GPT-4o 和 Gemini-1.5-Pro 等闭源模型,在多个公开基准上表现出色。

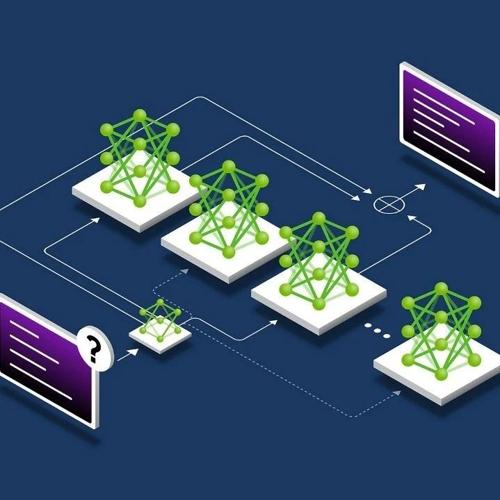

AI革新科研模式,上海AI Lab「AI4S攀登者行动计划」开放申请

AI4S攀登者行动计划旨在解决传统研究模式的限制,推动具有重大变革潜力的下一代技术。该计划聚焦发展跨学科颠覆式创新,并通过多维度的支持体系助力科研团队加速项目实施和价值转化。

贾佳亚团队联合Adobe提出GenProp,物体追踪移除特效样样在行

近日,贾佳亚团队联手 Adobe 团队提出 GenProp 模型。GenProp 能完成几乎所有 ‘传播’ 任务,并能追踪实例(如影子、反射),弥补感知模型缺陷。它还能移除物体的 side effects,插入独立运动物体,进行物体替换和背景替换,以及编辑特效。