量子位

量子位

40亿美元!Anthropic再获亚马逊新一轮投资,双方正合作开发AI芯片

Anthropic从亚马逊获得40亿美元投资,并将使用AWS Trainium和Inferentia芯片训练模型。双方合作开发定制AI芯片,允许客户使用自己的数据微调Claude模型。

AI模仿人类看漫画,视频大模型时序定位能力新SOTA

NumPro通过为视频帧添加数字标识符的方式提升了视频大模型的时序定位能力。无需训练设置即可增强模型对事件发生时刻的理解,实验结果显示其显著优于现有方法,并且不影响模型通用视频理解能力。

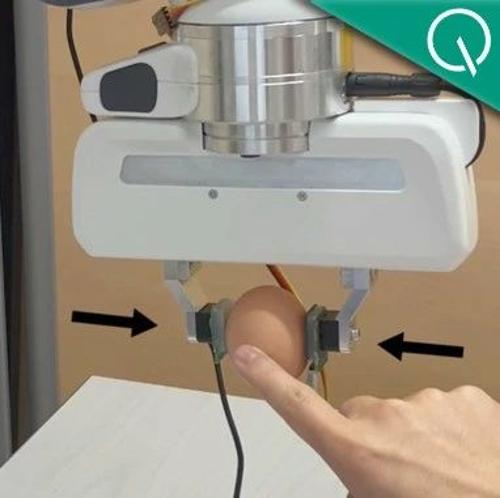

低成本机器人“皮肤”登上Nature子刊:实现三维力的自解耦,来自法国国家科学研究中心&香港大学

法国国家科学研究中心和香港大学的研究人员提出了一种基于柔性磁膜的触觉传感器,该传感器能够实现三维力的自解耦。通过设计正交磁化的Halbach阵列,可以简化传感器结构并降低标定复杂度,为低成本的三维力触觉传感提供了新思路。

Claude自动玩崩铁清日常,NUS新论文完整测评AI电脑操控:GUI智能体的黎明

新加坡国立大学团队测试发现,AI系统Claude可以在多个场景下自动完成任务,包括玩手游、购物下单、办公自动化等。Claude不仅能操作GUI界面,还能理解游戏规则并调整策略,展示了其在多种任务中的强大能力。论文还提出了一种开箱即用的自动GUI框架。

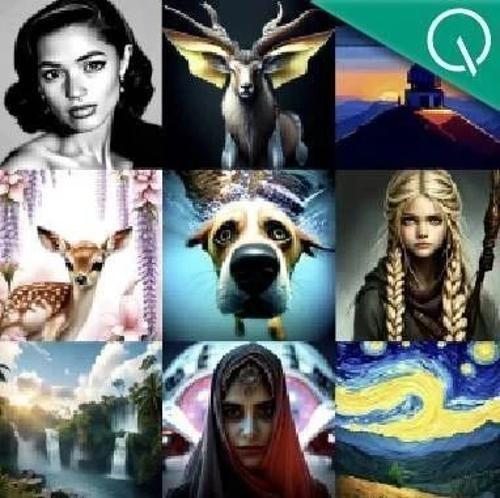

刚刚,沈向洋官宣通用视觉大模型!无需提示,就能识别万物

IDEA研究院最新成果DINO-X通用视觉大模型,在各种开发世界感知和目标理解任务中实现全面检测、泛化能力增强、细粒度目标理解和多任务感知,已在多个基准测试中获得新SOTA成绩。

百度AI营收占比翻倍,净利润涨12%,李彦宏主动剧透新版文心大模型

百度第三季度生成式AI收入占比从5%增长至11%,文心大模型日均调用量达15亿次。智能云业务中,AI云业务营收占比提升显著。李彦宏预计明年年初推出新版本的文心大模型。

DeepSeek等团队新作JanusFlow: 1.3B大模型统一视觉理解和生成

Janus团队提出了一种名为JanusFlow的新模型,该模型结合了预训练视觉编码器与MLM的方法以及基于Rectified Flow的生成框架,实现了统一的视觉理解和生成能力。通过将理解与生成任务分别配置专用编码器,并利用REPA方法加速生成训练,JanusFlow在多模态理解和生成任务上表现出色。