量化

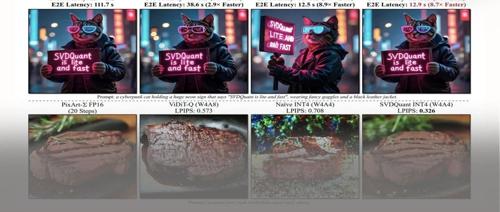

扩散模型部署有新解,直接量化为4bit?韩松团队等提出SVDQuant:16GB笔记本上加速8.7 倍

↑ 点击

蓝字

关注极市平台

作者丨科技猛兽

编辑丨极市平台

极市导读

在 12B FLUX.1-d

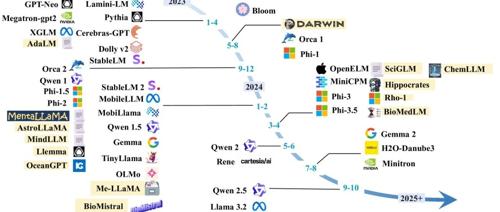

一篇小型语言模型技术最新全面综述

小型语言模型因其低延迟、成本效益等优势受到青睐,特别适用于资源受限的环境和领域知识获取。介绍了构建SLMs的基础概念及技术,如架构、训练技术和从大型语言模型(LLMs)获取SLMs的方法,包括剪枝、知识蒸馏和量化。分析了SLMs在问答、编程、推荐系统等领域的应用,并讨论了在移动设备上的部署策略。