函数调用

一文精讲 – MCP与LLM函数调用的区别

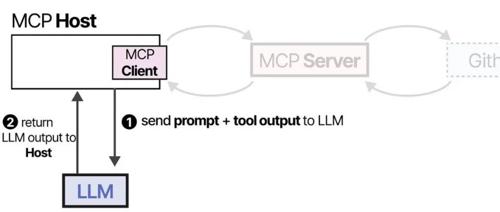

LLM函数调用与MCP(模型上下文协议)是两种不同的技术方案。LLM函数调用允许大型语言模型生成用于调用外部函数的JSON格式输出;而MCP提供了一个标准化框架,让AI模型通过统一接口访问不同工具和服务,增强了可扩展性和效率。

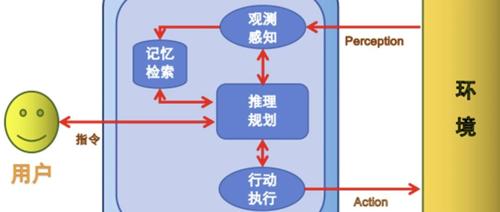

关于智能体Agent的实现技术之思维链和函数调用(function call)的思考

智能体、思维链和函数调用是实现人工智能的一个重要方向。本文深入解释了这三个概念的区别与联系,并讨论了它们在大模型中的应用和挑战。

速递|OpenAI新模型定价为DeepSeek的一千倍,o1-pro API为其目前最贵模型

OpenAI 推出更强大的 o1-pro AI 模型,比标准版本 o1 高十倍收费,但用户反映在解决复杂问题时表现不佳。

OpenAI o3-mini:用小模型改写AI推理规则的「科学狂人」

OpenAI发布的o3-mini模型实现了GPT-4级别的STEM能力,数学竞赛准确率达83.6%,推理速度提升24%。这款高性价比模型支持三档动态算力调节,并且首次向免费用户开放。

OpenAI狂打“骨折价”的一天:暴降成本开放全新o1,实时 API 全面降价 60%

今日,OpenAI推出功能更强大的模型API(o1)、降低实时API定价并发布多项更新。此外,还推出了新的偏好微调技术以帮助开发者定制模型。

AI能办专属信用卡了,Agent自己赚钱自己花,OpenAI合作伙伴打造

Stripe发布SDK允许AI智能体使用一次性虚拟卡完成金融支付,支持与Vercel、LangChainAI和CrewAIInc等集成。这意味着今后“AI助理”能帮用户完成整个交易流程,包括订机票付款,还能开具发票、自己赚取收益。