复旦大学

低Token高精度!字节复旦推出自适应推理框架CAR

复旦大学余海洋与字节的研究人员提出CAR自适应推理框架,根据模型困惑度动态选择短回答或长文本推理,在多模态视觉问答和关键信息提取任务中实现最佳平衡。

Agent主题百校联动,首场来北大了!

2025年5月26日,Datawhale与字节跳动扣子空间联合主办‘AI+X高校行’首场活动在北大启动,聚焦Agent技术普及,覆盖百所高校,提供从理论到实践的学习体验。

首个多模态统一CoT奖励模型来了,模型、数据集、训练脚本全开源

腾讯混元等联合提出的新模型UnifiedReward-Think能进行长链式推理,首次让奖励模型在视觉任务上真正 ‘学会思考’。该研究提出了三阶段训练框架,并展示了其在多个视觉任务中的出色表现和可靠性。

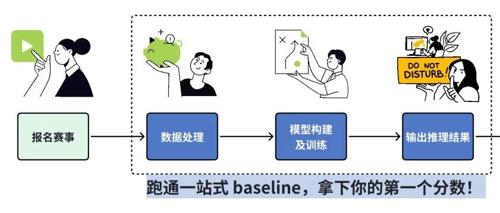

小白逆袭指南:半小时搞定世界顶级AI大赛(新能源赛道)

第三届世界科学智能大赛聚焦航空安全、材料设计等五大赛道,提供百万奖金。赛事通过预测新能源发电量帮助电网稳定运行。数据包括历史发电数据和气象预报数据,参赛者需训练AI模型以提高预测精度。

UniToken:多模态AI的“全能选手”,一次编码搞定图文理解与图像生成!

复旦大学和美团的研究者们提出UniToken——一种创新的统一视觉编码方案,在一个框架内兼顾图文理解与图像生成任务,并在多个权威评测中取得领先性能表现。

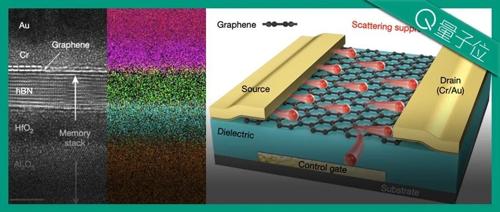

“史上最快闪存技术”登Nature!复旦新成果突破闪存速度理论极限,每秒执行操作2500000000次

复旦团队研发的皮秒闪存器件’破晓(PoX)’在Nature发表,其擦写速度达到亚纳秒级(<10^-9秒),比现有技术快1万倍。该器件使用石墨烯等二维材料制作,具有高循环寿命和数据持久性。

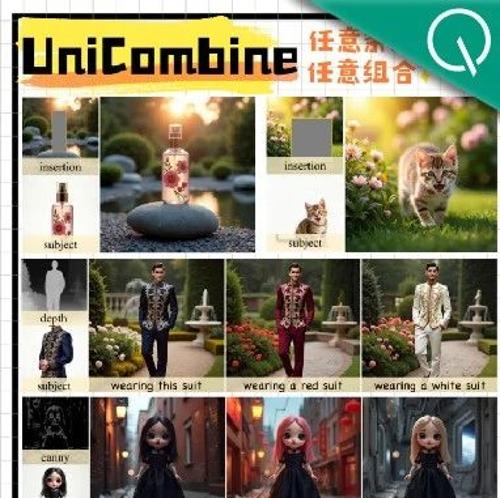

多模态生成框架新SOTA:文本+空间+图像随意组合,20W+数据开源,复旦腾讯优图出品

复旦大学、腾讯优图实验室等机构的研究人员提出UniCombine框架,能够处理多种条件组合的多条件可控生成任务,并在多个实验中达到SOTA。

超越ControlNet!复旦联合腾讯优图提出AI生图新框架,解决多条件生成难题

复旦大学和腾讯优图实验室提出PixelPonder,一种新的多视觉控制框架。它解决了当前方法在组合多个异构控制信号时面临的挑战,显著提高图像生成的可控性和文本一致性。