大语言模型

重磅!OpenAI发布满血o1、无限使用,最强大模型来了

专注AIGC领域的专业社区报道了微软&OpenAI等大语言模型的发展和应用。近日OpenAI发布了ChatGPT Pro,并宣布12天技术分享直播已启动。o1模型数据及训练涉及多样化的公开与非公开数据集,且具备自我改进能力。

精度与通用性不可兼得,北大、华为理论证明低精度下Scaling Law难以实现

大模型量化通过降低精度来提高推理速度,但研究发现不同精度下大语言模型在基本数学任务上的表现显著下降。研究证明足够的精度是解决这些任务的重要前提,而量化会严重损害大模型的数学推理能力。

NeurIPS 2024 多样任务真实数据,亚马逊提出在线购物领域评测基准Shopping MMLU

在线购物是现代生活中必不可少的组成部分。2023 年,在线购物销售额已经占到中国全部销售额的 46%

多样任务真实数据,大模型在线购物基准Shopping MMLU开源|NeurIPS&KDD Cup 2024

基于亚马逊真实购物数据,港科大与圣母大学联合构建了大规模评测基准Shopping MMLU,评估大语言模型在线购物领域的应用潜力。该基准覆盖多项任务及能力,强调多任务学习、少样本学习和特定领域知识理解的重要性,并且已被公开用于研究和应用。

LLM也怕你妈叫你回家吃饭这种模糊请求,纽大提出指导LLM澄清问题

MLNLP社区致力于促进国内外自然语言处理领域内的学术交流与进步。该论文提出了一种新的标注方法,用于训练LLMs在多回合交互中询问澄清问题,显著提高了其在处理模糊请求时的性能。

可以实现零代码开发的OPPO智能体平台,到底强在哪?

第三届中国高校计算机大赛——智能交互创新赛在杭州举行,OPPO提供技术支持和平台支持。哈尔滨工业大学的《雅韵智诵》获特等奖,四川大学的《走心》项目通过大模型代理集成到互动小说游戏中实现心理健康筛查。OPPO发布智能体开发平台,为开发者提供更多工具和支持,助力智能体技术的发展。

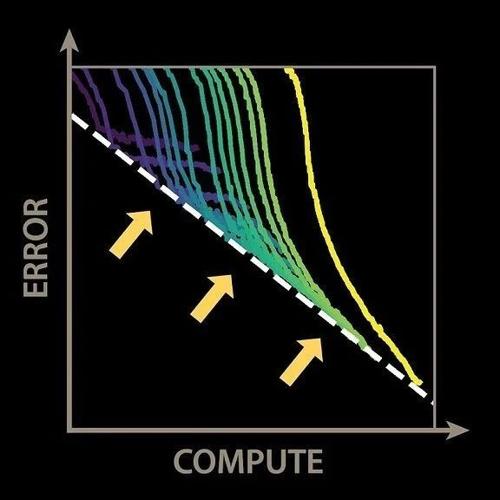

NeurIPS 2024 自我纠错如何使OpenAI o1推理能力大大加强?北大、MIT团队给出理论解释

AIxiv专栏介绍及其相关研究,讨论了大语言模型中的自我纠错能力,并提出了理论分析方法。该研究指出,自我纠错是一种上下文对齐过程,通过优化LLM的最终输出以获得更高的奖励。