AI探索时代

AI探索时代

关于工作流在人工智能领域内的应用分析

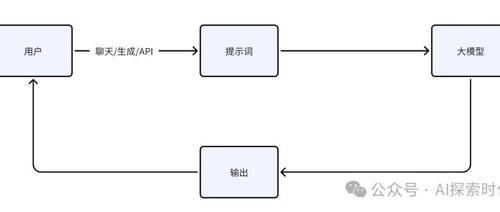

文章介绍了工作流与智能体在自动化任务中的作用,并指出其作为中间解决方案来解决大模型能力不足的问题。工作流通过定义执行流程并使用不同的工具(包括智能体)来完成特定任务。目前有很多平台支持这种工作流技术,如字节跳动的coze平台、开源Dify和德国产n8n等。

关于个人的创业想法——基于人工智能技术在垂直领域解决方案的探索

文章讲述了作者从技术开发转向人工智能技术服务创业的想法及可行性分析。作者认为选择垂直领域切入,并结合自身技术优势为中小企业提供解决方案是一个可行的选择。

破解合规难题,AI高质量数据集建设正当时

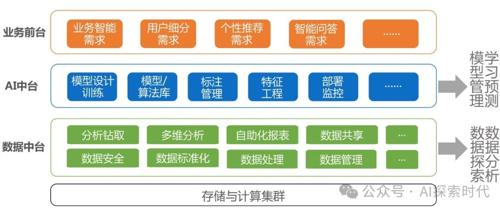

阿里开源的Qwen2.5系列训练数据规模达18万亿 token,推动AI大模型发展。但大规模训练带来幻象问题,RAG技术及工业场景应用以数据为中心成为趋势。国家和行业正积极推进数据标注产业发展规范,提升数据标注行业的合规能力。

大模型数据预处理——关于复杂文档在大模型应用中的解决方案

复杂文档处理是AI的基础但门槛高。常见文本类文档如Word/PDF格式复杂难处理,影响RAG应用效果。为提高效率,可将多种文档统一转为HTML或Markdown格式,并进行进一步处理。

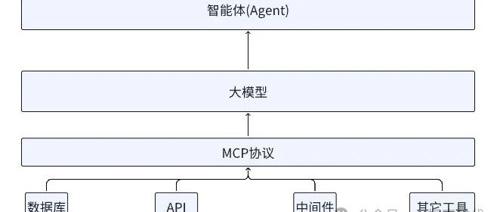

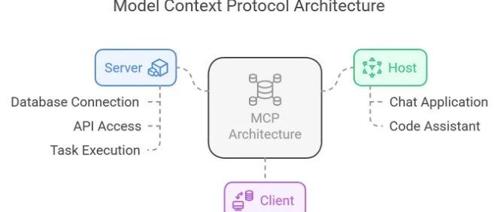

大模型从聊天走向智能体,智能体开发协议之——MCP协议的初步理解

智能体应用是大模型应用的一个重点方式,而如何让大模型根据指令完成任务成为热议话题。近期爆火的MCP协议提供了一个统一标准,通过C-S架构简化了大模型使用外部工具的过程。

12家单位已加入,全国首部AI大模型私有化部署标准欢迎参与!

《人工智能大模型私有化部署技术实施与评价指南》团体标准启动,旨在解决行业技术错配、流程不规范等问题,填补国内空白,促进高质量私有化部署及健康发展。

关于人工智能应用在科研领域方面的探索——中国科学院人才交流开发中心高级研修班

中国科学院人才交流中心举办人工智能研修班,旨在提升科研人员的数字化素养和应用能力。该研修班强调实际操作能力和创新能力培养,并通过线上线下同时进行的方式提供系统化培训。