SFT

Graph+图数据库+Agent能做什么?Chat2Graph的尝试思路

今天是2025年5月25日,星期日,北京,晴。文章讨论了技术问题,提到了一个名为Chat2Graph的技术项目,该项目使用图数据库和多智能体系统来实现自然语言与图形数据的交互,强调单主动-多被动混合架构、双LLM推理机及图规划器等关键技术细节。

360智脑开源Light-R1!1000美元数学上首次从零超越DeepSeek-R1-Distill

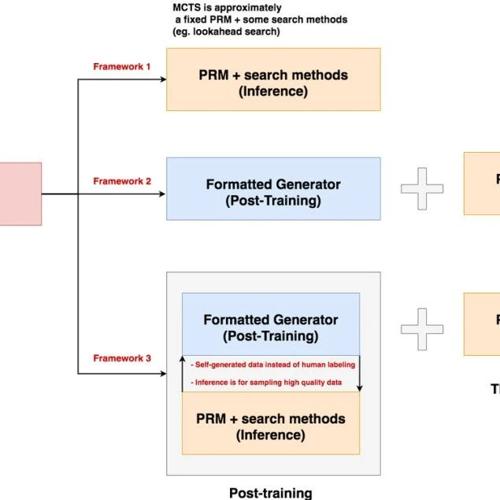

2B 模型,以及全部训练数据、代码。仅需 12 台 H800 上 6 小时即可训练完成,从没有长思维